42% planejam usar segurança de API para proteção de dados de IA

Embora 75% das empresas estejam implementando IA, 72% relatam problemas significativos de qualidade de dados e uma incapacidade de dimensionar práticas de dados, de acordo com F5.

Os dados e os sistemas que as empresas implementam para obtê-los, armazená-los e protegê-los são essenciais para o sucesso da adoção e otimização da IA.

“A IA é uma força disruptiva, permitindo às empresas criar experiências digitais inovadoras e incomparáveis. No entanto, os aspectos práticos da implementação da IA são incrivelmente complexos e, sem uma abordagem adequada e segura, podem aumentar significativamente a postura de risco de uma organização”, disse Kunal Anand , vice-presidente executivo e CTO da F5.

“Nosso relatório destaca uma tendência preocupante: muitas empresas, em sua ânsia de aproveitar a IA, ignoram a necessidade de uma base sólida. Essa supervisão não apenas diminui a eficácia de suas soluções de IA, mas também as expõe a uma infinidade de ameaças à segurança”, acrescentou Anand.

Empresas entusiasmadas com IA generativa

À medida que as empresas criam um novo conjunto para dar suporte à gama cada vez maior de serviços digitais baseados em IA, o estudo destaca os desafios que elas enfrentam em termos de infraestrutura, dados, modelo, serviços de aplicativos e camadas de aplicativos que devem ser superados para uma adoção escalável generalizada.

As organizações estão entusiasmadas com as perspectivas dos impactos comerciais da IA generativa . Os entrevistados a nomearam como a tendência tecnológica mais empolgante de 2024. No entanto, apenas 24% das organizações dizem que implementaram IA generativa em escala.

Embora o uso de IA generativa esteja aumentando , os casos de uso mais comuns geralmente atendem a funções menos estratégicas. Os casos de uso mais comuns que os entrevistados dizem já ter implantado incluem copilotos e outras ferramentas de produtividade de funcionários (em uso por 40% dos entrevistados) e ferramentas de atendimento ao cliente, como chatbots (36%).

No entanto, ferramentas para automação de fluxo de trabalho (36%) foram consideradas o caso de uso de IA de maior prioridade.

A maturidade dos dados representa um desafio maior de implementação de IA

À medida que os líderes empresariais examinam os desafios da implantação de aplicativos baseados em IA em escala, eles citam três principais preocupações encontradas na camada de infraestrutura:

- 62% citam o custo da computação como uma grande preocupação para o dimensionamento da IA

- 57% citam a segurança do modelo como a principal preocupação. Para resolver isso, os líderes empresariais esperam gastar 44% mais em segurança nos próximos anos à medida que dimensionam as implantações

- 55% dos entrevistados citam o desempenho em todos os aspectos do modelo como uma preocupação

Na camada de dados, a maturidade dos dados é um desafio mais imediato e potencialmente maior, com impacto na implementação generalizada da IA.

72% dos entrevistados do estudo citam a qualidade dos dados e a incapacidade de dimensionar as práticas de dados como os principais obstáculos para dimensionar a IA, e 53% citam a falta de habilidades de IA e dados como um grande impedimento.

Embora 53% das empresas afirmem ter uma estratégia de dados definida , mais de 77% das organizações entrevistadas afirmam que não têm uma única fonte de verdade para os seus dados

A cibersegurança continua a ser uma preocupação fundamental

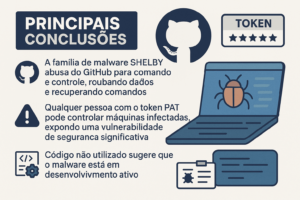

De acordo com o estudo, a segurança cibernética é uma preocupação principal para aqueles encarregados de fornecer serviços de IA. Fatores como ataques alimentados por IA , privacidade de dados, vazamento de dados e aumento de responsabilidade estão entre as principais preocupações de segurança de IA.

Quando perguntados sobre como planejam se defender contra essas ameaças para proteger implementações de IA (ou já estão fazendo isso), os entrevistados se concentram em serviços de aplicativos, como segurança de API, monitoramento e proteção contra DDoS e bots.

42% afirmam que estão usando ou planejam usar soluções de segurança de API para proteger dados enquanto eles atravessam modelos de treinamento de IA.

41% usam ou planejam usar ferramentas de monitoramento para visibilidade do uso de aplicativos de IA, 39% usam ou planejam usar proteção DDoS para modelos de IA e 38% usam ou planejam usar proteção de bot para modelos de IA.